Die magische Welt der Augmented Reality:

Inspirierende Beispiele für immersive Erlebnisse

Augmented Reality hat bereits jetzt einen festen Platz im Alltag vieler Menschen, auch wenn es ihnen vielleicht nicht so bewusst ist. QR-Codes finden sich so gut wie überall und “VR” (Virtuelle Realität) ist den meisten Leuten heute ein Begriff. Von beeindruckenden visuellen Erlebnissen bis hin zu praktischen Lösungen hat AR das Potenzial, unsere Realität zu erweitern und uns in eine ganz neue Dimension der Interaktion und Immersion zu führen. Tauchen Sie mit uns ein, während wir einige spannende Beispiele erkunden, wie AR unser Leben bereichert und unsere Wahrnehmung der Welt verändert!

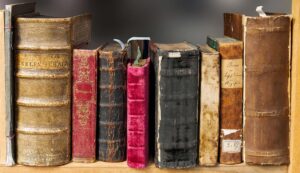

AR Navigation: Beispiel Google “Live View”

Die AR-Navigation bei Google Maps basiert auf der Integration von Augmented Reality in die bestehende Navigationsfunktionalität der Google Maps App. Hier ist eine grundlegende Beschreibung, wie sie funktioniert: [1]

1. Ziel eingeben: Zunächst gibt der Benutzer das gewünschte Ziel in die Google Maps App ein.

2. Fußgängernavigation starten: Sobald das Ziel eingegeben wurde, wird die Fußgängernavigation gestartet, indem der Benutzer auf den entsprechenden Button tippt.

3. AR-Modus aktivieren: Im Fußgängermodus erscheint ein AR-Button, der es dem Benutzer ermöglicht, die AR-Navigation zu aktivieren. Durch Tippen auf diesen Button wird die Kamera des Smartphones aktiviert.

4. Kameradisplay und AR-Overlay: Sobald die Kamera aktiviert ist, wird die Live-Ansicht der Umgebung des Benutzers auf dem Display angezeigt. Über diese Live-Ansicht legt Google Maps ein AR-Overlay mit Pfeilen, Richtungsanweisungen und Markierungen über das Kamerabild.

5. Wegweiser und visuelle Hinweise: Das AR-Overlay zeigt dem Benutzer Richtungspfeile und visuelle Hinweise, wie zum Beispiel Straßennamen oder Entfernungsangaben, direkt in der Kameraansicht an. So kann der Benutzer die Umgebung sehen und gleichzeitig visuelle Anweisungen erhalten.

6. Fortlaufende Navigation: Der Benutzer folgt den AR-Anweisungen und setzt die Navigation fort, wobei ihm kontinuierlich visuelle Hilfestellungen zur Verfügung gestellt werden.

Abbildung 1: (Quelle: https://support.google.com/maps/thread/12938628/neu-in-google-maps-augmented-reality-mit-liveview?hl=de)

Einschränkungen

Da diese Technologie sich an der Umgebung orientiert, gibt es für die Navigation jedoch einige Einschränkungen. Im speziellen Fall der Google Maps Navigation ist eine gute Street View Abdeckung der Region Voraussetzung, damit die “Live View” überhaupt verfügbar wird. Des Weiteren muss die Kamera beim Aktivieren auf Gebäude und Schilder gerichtet werden, um sich orientieren zu können. Wenn es nicht genug Orientierungspunkte gibt, schlägt die Navigation fehl. Außerdem gilt auch bei dieser Art von Navigation dasselbe wie bei jedem Navi: Das selbstständige Mitdenken im Straßenverkehr kann von der App nicht übernommen werden und es kann zu Fehlern kommen. Ein weiteres Problem ist der Akkuverbrauch, der sich bei dieser Navigationsart enorm erhöht, weshalb es empfehlenswert ist, dies wirklich nur dort zu verwenden, wo es nötig ist, und sobald man sich einmal orientiert hat, auf die ursprüngliche Kartennavigation zurückzuschalten.

Chancen

AR-Navigation bietet jedoch nicht nur Menschen, die in unübersichtlichen Straßen die Orientierung verloren haben, Chancen. Die Technologie kann auch anderweitig genutzt werden, um im Alltag einen Mehrwert zu schaffen. Für blinde Personen kann dies einen unglaublichen Mehrwert bieten, indem Objekte, Geschäfte und Straßen in Echtzeit von der Kamera erfasst und in digitale Objekte umgewandelt werden. Dadurch wird es möglich, die Kamera als “Augenersatz” zu verwenden und die Orientierung über haptische Orientierungspunkte wie Leitlinien, Bordsteinkanten und ähnliches zu erweitern, indem beispielsweise eine Sprachausgabe hinzugefügt wird. Auf diese Weise wird unsere Welt ein kleines Stück inklusiver gemacht.

AR in der Archäologie: Beispiel Ephesos Marmorsteinbruch

Ein weiteres Anwendungsgebiet für die AR-Technologie ist die Archäologie. Vor zwei Jahren hatte man die Möglichkeit, an der FH Technikum Wien im Rahmen der Karrieremesse in der Startup Corner einen Prototypen auszuprobieren, bei dem man Grabungsstätten mittels VR “live” erleben konnte. Dabei wurde die Grabungsstätte vermessen und 3D-Bilder im Maßstab aufgenommen. Diese Bilder wurden dann mithilfe einer Software über eine VR-Brille dargestellt. Der Benutzer setzt die Brille auf und befindet sich sozusagen in der Grabungsstätte. Durch Kopfbewegungen kann die Ansicht geändert werden. Oftmals wird dies mit Interaktionselementen an interessanten Stellen kombiniert, die zusätzliche Informationen in Form von eingeblendeten Texten bieten. Man kann dies auch zu Hause ausprobieren, da das Österreichische Archäologische Institut ein 3D-Modell der

Ausgrabungsstätte in Ephesos zur Verfügung stellt, bei dem interessante Objekte mit zusätzlichen Fotos und Informationen versehen sind. [2]

Abbildung 2: 3D-model and text: OeAW-OeAI/V. Anevlavi, C. Kurtze, January 2019. Austrian Academy of Sciences. Austrian Archaeological Institute, Vienna. (Quelle: https://sketchfab.com/)

Einschränkungen

Ausgrabungsstätten sind von Natur aus schwierig zu erforschen, da äußerste Vorsicht geboten ist, um keine Materialien zu zerstören. Dies erschwert die Aufnahme von guten und umfassenden Bildern aus allen Blickwinkeln, da nicht überall ein Stativ aufgestellt werden kann. Zudem sind die Kosten nicht zu vernachlässigen, da auch technische Expertise benötigt wird. Es kann zudem nicht ausgeschlossen werden, dass bei der Bildaufnahme einzelner Gegenstände diese beschädigt werden, weshalb diese Technik nicht uneingeschränkt bei allen Objekten angewendet werden kann. Außerdem sollten ethische Aspekte berücksichtigt werden, insbesondere wenn es sich beispielsweise um menschliche Überreste handelt.

Chancen

Die Möglichkeit, Relikte aus der Vergangenheit mithilfe von Software zugänglich zu machen, bietet natürlich eine riesige Chance für die Bildung und Weiterbildung von Menschen. Indem man Dinge “erlebbar” macht, hilft es vielen Menschen enorm beim Lernen. Es ist viel

einfacher, sich etwas zu merken, wenn man es gesehen hat, damit interagieren konnte und vielleicht sogar in Zukunft die Möglichkeit hat, Dinge anzufassen. Aber nicht nur zur Vermittlung von bestehendem Wissen ist dies äußerst praktisch, sondern auch zur Generierung neuen Wissens kann AR in der Archäologie genutzt werden. Bei vielen Gegenständen lässt es sich nicht verhindern, dass sie sich im Laufe der Zeit

abnutzen und Informationen verloren gehen. Daher ist es oft nicht erlaubt, die Gegenstände anzufassen. Die virtuelle Darstellung ermöglicht es Forscherinnen und Forschern jedoch, das Objekt ausführlich zu betrachten, ohne die Gefahr, etwas unwiederbringlich zu verlieren

oder zu zerstören. Dadurch ergeben sich auch weitere Chancen: Viele Museen und Forschungsinstitute haben in den letzten Jahren intensiv daran gearbeitet, Gegenstände zurückzugeben, die unrechtmäßig in ihren Besitz gelangt sind. Dies kann aus Forschungsgründen zwar einen Verlust darstellen, auch wenn es ethisch richtig ist. Eine digitale Kopie ermöglicht es, diesen ethischen Standards gerecht zu werden und gleichzeitig das Wissen nicht nur zu bewahren, sondern auch weiterhin die Möglichkeit zu haben, neues Wissen zu generieren.

Abbildung 3: (Quelle: https://pixabay.com/de/photos/buchen-lesen-alt-literatur-b%C3%BCcher-1659717/

Abbildung 3: (Quelle: https://pixabay.com/de/photos/buchen-lesen-alt-literatur-b%C3%BCcher-1659717/

Mittels AR haptisches Erleben: Beispiel haptische Handschuhe

Das Metaverse ist seit dem Start der ersten VR-Brille keine reine Fiktion mehr. Neben Phänomenen wie VR-Tube und virtuellen Konferenzräumen fehlt dem Metaverse jedoch noch ein entscheidender Faktor für viele Arbeitsplätze: das haptische Feedback. Obwohl Ton und Bild uns bereits geliefert werden können und virtuelle “Stand-Ups” ermöglicht werden, verschwindet die Illusion, sobald wir versuchen, in der virtuellen Welt etwas mit unseren Händen zu berühren. Wir spüren… nichts. Obwohl unser Gehirn einen Gegenstand vor uns wahrnimmt, da diese Information von unseren Augen übermittelt wird, besteht eine Diskrepanz zwischen unseren physischen und audiovisuellen Sensoren, die bei einigen Menschen auch deutliches Unwohlsein auslösen kann. Doch was wäre, wenn dieses Problem bereits gelöst wäre? Im Bereich der Videospielentwicklung gibt es bereits enorme Fortschritte. Mit Hilfe von Vibrationen und elektrischem Widerstand kann zum Beispiel im VR-Gaming-Bereich das Spannen eines Bogens simuliert werden. Es gibt spezielle Controller für verschiedene Spielarten, und beim virtuellen Tennis spürt man bereits ein haptisches Feedback, wenn der “Schläger” den Ball berührt. Die Weiterentwicklung dieser Technologie umfasst haptische Handschuhe, und das Beste daran ist: Sie sind keine Fiktion mehr. Durch verschiedene Sensoren, kleine Motoren oder sogar Luft, wie bei einer Blutdruckmanschette, wird dafür gesorgt, dass passend zu dem Bild, das wir sehen, auch ein Feedback an unsere Haut auf den Händen weitergegeben wird.

Einschränkungen

Da es sich um eine relativ neue Technologie handelt, kann sie unter Umständen noch recht teuer sein. Die SenseGlove Nova Handschuhe kosten knapp 5000 € und sind daher eigentlich nichts für den privaten Haushalt. Auch im Geschäftsbereich muss der Mehrwert sorgfältig hinterfragt werden. [3] Vor allem, weil die Handschuhe allein nicht ausreichen. Zusätzlich wird ein VR-Headset und die entsprechende Software benötigt. Es gibt sicherlich Anwendungsfälle, in denen es sinnvoll sein kann, insbesondere wenn man weiß, dass man in Zukunft vermehrt im Bereich der Mixed Reality arbeiten wird. Zum jetzigen Zeitpunkt gibt es jedoch noch viele Fragezeichen hinsichtlich der Kosten, der Hardware und vor allem der Software.

Chancen

Wie bereits angedeutet, liegt die Chance von haptischen Handschuhen sicher nicht darin, dass man ein virtuelles Post-It auf einem Board spürt. Die Möglichkeiten liegen vielmehr in Branchen, die mit virtuellen Modellen arbeiten und mit ihnen interagieren. Für Unternehmen, die greifbare neue Produkte entwickeln, mag die Einstiegshürde zunächst hoch sein. Doch die Fähigkeit, auf Designmängel an einem virtuellen Objekt aufmerksam zu werden, erspart wiederum die Kosten für die Herstellung eines physischen Prototyps und kann langfristig ein Gewinn sein.

Auch das virtuelle Training von Personal kann sinnvoll sein, insbesondere in Arbeitsbereichen, die sehr sensibel sind, wie bei angehenden Chirurgen oder im militärischen Kontext. In beiden Fällen kann haptisches Feedback neben dem virtuellen Simulationstraining entscheidend sein. Gleichzeitig sind dies Szenarien, in denen man nicht an echten Lebewesen üben möchte.

AR am Arbeitsplatz: Beispiel Spacetop

Abseits von virtuellen Meetings im Metaverse gibt es auch andere Anwendungsmöglichkeiten von AR im Arbeitsalltag. Eine der neuesten Entwicklungen in diesem Bereich ist der “Spacetop”. Viele Menschen kennen das Problem: Man arbeitet mit fünf verschiedenen Fenstern gleichzeitig an seinem Computer, und der Bildschirmplatz reicht einfach nicht aus. Insbesondere im Homeoffice kann es vorkommen, dass der Schreibtisch nicht genug Platz für zusätzliche Monitore bietet. Auch das Arbeiten und Reisen ist inzwischen in der digitalen Arbeitswelt angekommen, und wenn man mit einem Wohnmobil unterwegs ist, hat man eher weniger Möglichkeiten, mehrere Monitore zu nutzen.

Dieses Problem wird vom “Spacetop” adressiert. Dabei handelt es sich um einen Laptop ohne physischen Bildschirm. Stattdessen projiziert eine Brille adaptiv die Fenster “in die Luft”, und man kann ohne echte Monitore mehrere Bildschirme bedienen. Der Laptop wird von dem Startup “Sightful” entwickelt und vertrieben. Wie gut sich diese Innovation wirklich in den Arbeitsalltag integrieren lässt und ob wir in Zukunft tatsächlich alle am Strand liegen werden, bleibt abzuwarten.

Abbildung 3: (Quelle: https://www.sightful.com/)

Abbildung 3: (Quelle: https://www.sightful.com/)

Fazit

AR findet inzwischen in vielen Bereichen Anwendung, auch wenn einige Innovationen sicherlich noch Verbesserungspotenzial haben. Es gibt zahlreiche Beispiele, und dies war nur ein kleiner Ausblick auf das, was mit AR alles möglich ist. Von der Microsoft Hololens bis hin zu Projektionen für Chirurgen sind die Möglichkeiten endlos, und es bleibt spannend, was die Zukunft bringen wird.

Quellen

• [1] https://support.google.com/maps/answer/9332056?hl=de&co=GENIE.Platform%3DiOS&sjid=261191475386534162-EU#zippy=%2Cunterwegs-mit-live-view%2Csichmit-live-view-orientieren

• [2] https://sketchfab.com/3d-models/ephesos-ancient-grey-marble-quarryb4b8aa79d9bf4dc9ade18026b7f78801?ref=related

• [3] https://immersive-display.com/de/geraete/828-senseglove-nova-haptische-virtualreality-handschuhe.html

• https://www.museum4punkt0.de/ergebnis/historische-buecher-mit-augmented-realityentdecken/

• https://www.sightful.com/

Weiterführende Informationen

• https://www.oeaw.ac.at/oeai/oeaidigital/laufende-projekte/3d-vr-and-ar-projects

0 Kommentare